I also deleted an empty blobs folder and it took a long time just to remove 4000ish empty directories

Me too, and now I have a ton of info queues. There needs to be some automation so that when the migration is finished, the blobs and trash folders are emptied, at least the empty ones, and the info that the migration is finished disappears.

@arrogantrabbit , My node is running on Windows 10, I have 32GB of memory and Storj has consumed 28GB of memory, is there a way to limit Storj when memory consumption reaches 30GB?

because it seems like storj will consume RAM memory until it runs out, even to the point of swap memory, cmiiw

not exactly, my nodes with 96gb of RAM consumed 90 and not going more.

I’m curious about memtbl nodes. What happens if they reach the maximum system RAM.

yeah me too, is it possible that the system will crash

it will start to use swap and will be slow.

General comment here… since what started as a post with a question has been turned into a wiki type entry, can the subject be updated to something more appropriate? “Hashstore Migration Guide - Wiki” for example? At minimum remove the question mark I guess. Not sure if this forum allows editing (without backend DB access) of a thread title.

Good idea, done. I thought everyone can edit above basic trust level?

for us windows users, outside of doing this to cleanup empty blobs folder -are there any other commands we should do to clean anything up?

Hello @thelastspark,

Welcome back!

I do not know. You will tell us in time ![]()

Вадим!

К тебе просьба, ты как один из немногих виндузятников здесь, не мог бы подсказать, как мне запустить один узел в memtable через yaml?

Хочу проверить твою теорию о увеличении трафика при использовании memtable.

Спасибо.

присоединяюсь к вопросу

![]()

Fair enough, I’ll keep an eye on stuff but I’m sadly just not that IT savy (decent at software coding tho)

Ja ispolzoval envirement variebla, poetomu config comandu ne usnoval.

Вадим спасибо за обратную связь!

Алексей!

Не подскажите есть ли вариант запустить одну ноду с использованием memtable при помощи переменных в файле yaml ?

Спасибо.

Насколько я знаю, эти параметры добавлены в новой версии узла.

Проверьте:

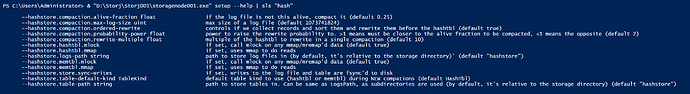

& "C:\Program Files\Storj\Storage Node\storagenode.exe" setup --help | sls "hash"

Если у вас уже такая версия, то там должна быть опция:

Любую такую можно добавить в config.yaml как параметр, в данном случае -

hashstore.table-default-kind: memtbl

Как обычно, надо сохранить config.yaml и перезапустить узел. Опция применится после следующего сжатия (compaction).

Алексей, позвольте задать еще один вопрос.

У меня имеется простаивающий ssd micron на 16тб с ресурсом перезаписи 5 раз в день.

Если перенос таблиц хешей даст моей системе хотя бы немного меньше двигать головками блинов, я бы хотел перенести работу с таблицами на ssd.

Здесь возникает вопрос.

Есть переменная:

–hashstore.table-path string path to store tables in. Can be same as LogsPath, as subdirectories are used (by default, it’s relative to the storage directory) (default “hashstore”)

Мне достаточно прописать путь к каталогу с таблицами на ссд и перезапустить узел, либо я должен создать каталог, остановить ноду, что-то скопировать уже существующее в этот каталог и запустить ноды.

Спасибо.

Не даст, не тратьте время. Для глобальной сети эти мс пока что не имеют никакого значения, но увеличивают количество точек отказа. Если есть RAM, рисковать потерей узла разделением метаданных и данных не имеет никакого смысла, особенно с учётом, что у вас даже не raspi 2, даже не чихнёт. Хотя, если Windows, у вас будут проблемы до следующей версии, но только если у вас больше 3 узлов на сервер. Это не связано с типом (memtable/non memtable), а с тем, что Windows не лучшая ОС для сервера.

См. Windows GUI node consume big amount of virtual memory

Вы можете сделать узел немного быстрее (если у вас действительно упирается в диск), если будете использовать tiered storage. Т.е. SSD как “отстойник” для горячих данных, прежде, чем они отправятся на HDD.

FYI: Текущий максимум для SATA III 6 Gbps.